In questo articolo, Data Center e Cloud Computing, analizziamo le infrastrutture che permettono l’elaborazione, l’archiviazione e la distribuzione dei dati, dai data center al Cloud

Indice dei contenuti

- Introduzione

- Cos’è un Data Center

- Componenti principali di un Data Center

- Virtualizzazione nei Data Center

- Sicurezza e continuità del servizio nei Data Center

- Cloud Computing

- Dal possesso al servizio

Introduzione

I data center rappresentano il cuore dell’infrastruttura digitale moderna. Sono strutture fisiche dedicate all’elaborazione, archiviazione e distribuzione dei dati e dei servizi informatici, utilizzati sia da aziende che da fornitori di servizi cloud. Il loro ruolo è cruciale: ospitano server, sistemi di storage e reti che permettono alle applicazioni di funzionare in modo affidabile e scalabile.

Cos’è un Data Center

Un data center può essere visto come un “cervello digitale” centralizzato, progettato per supportare grandi volumi di dati, utenti e applicazioni. È una struttura complessa che integra hardware, software, alimentazione elettrica ridondata, sistemi di raffreddamento, sicurezza fisica e logica, e connettività di rete ad alta velocità.

I data center possono essere di diverse tipologie:

- Enterprise Data Center → gestiti internamente da aziende per scopi specifici.

- Colocation Data Center → ospitano server di più aziende in uno spazio condiviso, offrendo servizi di rete e alimentazione.

- Cloud Data Center → gestiti da fornitori di servizi cloud, accessibili via Internet e progettati per scalabilità dinamica.

Componenti principali di un Data Center

Un data center si basa su tre pilastri principali: Calcolo, Storage e Rete, supportati da infrastrutture ausiliarie per garantire continuità e sicurezza.

Calcolo e RAM

Questa componente comprende:

- Server fisici o virtualizzati, dotati di CPU e RAM.

- Capacità di elaborazione dimensionata in funzione del numero di utenti e del tipo di applicazioni.

I server eseguono applicazioni, gestiscono database e elaborano richieste degli utenti. La RAM (Random Access Memory) fornisce memoria temporanea ad alta velocità, essenziale per garantire prestazioni elevate.

Storage

Il sistema di archiviazione gestisce i dati permanenti. Può includere:

- DAS (Direct Attached Storage) → storage locale direttamente connesso al server.

- NAS (Network Attached Storage) → storage condiviso accessibile tramite rete.

- SAN (Storage Area Network) → rete dedicata ad alte prestazioni per lo storage centralizzato.

I data center moderni adottano spesso soluzioni di storage ridondante, replicando i dati su più dispositivi o località per garantire resilienza e disponibilità continua.

Rete (Networking)

La componente di rete assicura la connessione tra server, storage e utenti finali, sia all’interno del data center sia verso l’esterno. Include:

- Switch e router ad alte prestazioni, spesso in configurazioni ridondate.

- Firewall e sistemi di sicurezza per proteggere dati e applicazioni.

- Connessioni a Internet ad alta velocità, spesso su più provider per garantire ridondanza.

La rete interna del data center deve garantire latenza minima, larghezza di banda sufficiente e resilienza in caso di guasti.

Virtualizzazione nei Data Center

La virtualizzazione rappresenta uno dei concetti chiave che hanno trasformato i data center moderni. Essa consiste nella creazione di risorse “virtuali” indipendenti dall’hardware fisico sottostante, consentendo di eseguire più sistemi operativi, applicazioni o servizi su un singolo server fisico. In pratica, un unico server può comportarsi come se fossero presenti più macchine separate, ottimizzando l’utilizzo delle risorse e riducendo costi e complessità.

Dai sistemi fisici a quelli virtuali

Tradizionalmente, ogni server fisico era dedicato a un’applicazione specifica, spesso con molte risorse inutilizzate. Con la virtualizzazione:

- l’hardware fisico diventa piattaforma condivisa,

- il carico di lavoro viene distribuito su macchine virtuali (VM),

- ogni VM ha il proprio sistema operativo, memoria, storage e interfaccia di rete, indipendenti dalle altre VM.

Questo approccio consente di consolidare server, ridurre il numero di macchine fisiche e semplificare la gestione del data center.

Funzionamento: l’Hypervisor

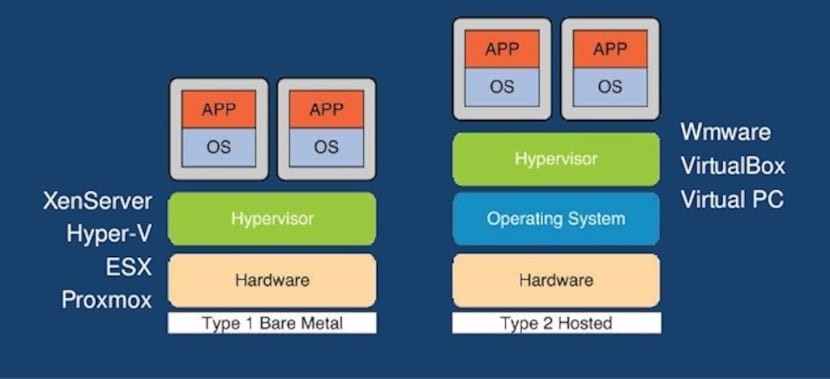

Il componente centrale della virtualizzazione è l’hypervisor, un software che crea e gestisce le macchine virtuali. Esistono due principali tipi:

Hypervisor di Tipo 1 (Bare-metal)

- Installato direttamente sull’hardware fisico.

- Esempi: VMware ESXi, Microsoft Hyper-V, XenServer.

- Vantaggi: alte prestazioni, minore latenza, maggiore sicurezza.

- Utilizzato principalmente nei data center professionali.

Hypervisor di Tipo 2 (Hosted)

- Installato sopra un sistema operativo host.

- Esempi: VMware Workstation, Oracle VirtualBox.

- Vantaggi: facile da installare e utilizzare, ideale per test e sviluppo.

- Limitazioni: prestazioni leggermente inferiori rispetto al Tipo 1, maggiore dipendenza dall’OS host.

Virtualizzazione delle risorse

La virtualizzazione non si limita ai server: riguarda anche altre componenti chiave del data center.

Server Virtuali

- Un singolo server fisico può ospitare più macchine virtuali.

- Ogni VM può essere assegnata a un reparto o servizio differente.

Storage Virtuale

- I sistemi di storage fisico vengono aggregati e presentati come pool virtuali.

- Le applicazioni possono accedere allo storage senza conoscere la sua posizione fisica.

Rete Virtuale

- Switch e router fisici vengono sostituiti o integrati da network virtuali.

- È possibile creare VLAN, segmentare il traffico e gestire la sicurezza in modo più flessibile.

Desktop Virtuale

- Gli utenti finali possono utilizzare macchine virtuali remote, ospitate nel data center, tramite protocolli come VDI (Virtual Desktop Infrastructure).

- Vantaggi: gestione centralizzata, aggiornamenti semplificati, sicurezza dei dati.

Virtualizzazione delle Applicazioni

- Le applicazioni vengono eseguite in ambienti isolati senza necessità di installazione locale.

- Consente di ridurre conflitti tra software e semplificare la distribuzione su larga scala.

Vantaggi della virtualizzazione

- Efficienza delle risorse → maggiore utilizzo dei server fisici.

- Flessibilità e scalabilità → creazione rapida di nuove VM in base al carico.

- Riduzione dei costi → meno hardware da acquistare e mantenere.

- Gestione semplificata → backup, migrazione e ripristino più rapidi.

- Isolamento e sicurezza → problemi in una VM non compromettono le altre.

Limiti e considerazioni

- Prestazioni → l’overhead dell’hypervisor può influire sulle applicazioni ad alte prestazioni.

- Complessità → la gestione di molte VM richiede strumenti avanzati di monitoraggio e orchestrazione.

- Sicurezza → un hypervisor compromesso può influire su tutte le VM ospitate.

- Licenze software → ogni VM può richiedere licenze separate, aumentando i costi.

Tipologie di Data Center Virtuali

On-Premise

I data center virtuali on-premise sono gestiti direttamente dall’azienda all’interno dei propri locali o edifici.

Caratteristiche principali:

- Hardware e infrastruttura controllati internamente.

- Maggiore controllo su sicurezza e configurazioni.

- Possibilità di definire completamente lo stack: sistema operativo, hypervisor, template di macchine virtuali e allocazione di CPU, RAM, storage e networking.

- Ideale per applicazioni critiche o dati sensibili che richiedono conformità a normative specifiche.

Off-Premise

I data center virtuali off-premise si trovano fisicamente presso fornitori esterni di servizi cloud. Esempi: Amazon Web Services (AWS), Microsoft Azure, Google Cloud Platform (GCP).

Caratteristiche principali:

- Infrastruttura gestita da terzi, accessibile via Internet.

- Scalabilità rapida: è possibile aggiungere risorse in pochi minuti.

- Possibilità di scegliere sistemi operativi, template e configurazioni senza preoccuparsi dell’hardware sottostante.

- Include modelli IaaS (Infrastructure as a Service), PaaS (Platform as a Service) e SaaS (Software as a Service).

Personalizzazione e gestione

Nei data center virtuali, sia on-premise sia off-premise, è possibile configurare con precisione:

- Sistema operativo → ogni VM può eseguire Windows, Linux o altri OS a seconda delle esigenze.

- Hypervisor → scegliere il tipo (bare-metal o hosted) e il vendor, come VMware, Hyper-V o KVM.

- Template di macchine virtuali → preconfigurazioni di VM con software e impostazioni standard, che velocizzano il deployment di nuovi ambienti di lavoro.

- Risorse assegnate → CPU, memoria RAM, spazio storage, larghezza di banda di rete, bilanciamento del carico tra VM.

Questa flessibilità consente di creare ambienti su misura per singoli progetti, team o applicazioni aziendali, riducendo i tempi di provisioning e aumentando l’efficienza operativa.

Sicurezza e continuità del servizio nei Data Center

Un data center moderno non deve soltanto erogare servizi, ma deve garantire sicurezza, affidabilità e continuità operativa. L’infrastruttura deve essere progettata in modo da prevenire interruzioni, proteggere i dati e mantenere i servizi attivi anche in presenza di guasti o eventi critici.

Livelli di sicurezza

La sicurezza di un data center si articola su più livelli, ognuno con obiettivi specifici.

- Sicurezza perimetrale -> Riguarda la protezione fisica e logica del perimetro della struttura: Controllo accessi fisici (badge, biometria, videosorveglianza), Sorveglianza H24, Firewall e sistemi IDS/IPS per la protezione della rete, Segmentazione delle VLAN e controllo degli accessi di rete. L’obiettivo è impedire intrusioni non autorizzate, sia fisiche sia digitali.

- Sicurezza dell’infrastruttura -> Coinvolge server, rete, storage e sistemi di virtualizzazione: Ridondanza degli apparati di rete, aggiornamenti e patch management, hardening dei sistemi operativi, monitoraggio continuo delle prestazioni. Qui l’attenzione è rivolta alla resilienza tecnica dell’architettura IT.

- Sicurezza dei dati -> È il livello più critico: Crittografia dei dati a riposo (data at rest), Crittografia dei dati in transito (data in transit), Backup periodici, Controllo degli accessi basato su ruoli (RBAC). L’obiettivo è garantire integrità, riservatezza e disponibilità delle informazioni.

- Sicurezza ambientale -> Un data center deve proteggersi anche da eventi fisici: Impianti antincendio automatici, Sistemi di climatizzazione ridondati, UPS e generatori di emergenza, Sensori di temperatura e umidità. La componente ambientale è fondamentale per prevenire danni hardware e interruzioni improvvise.

Business Continuity e standard ANSI/TIA-942

Lo standard ANSI/TIA-942 classifica i data center in base al livello di affidabilità e ridondanza, definendo quattro livelli (Tier).

- Tier 1 ->Infrastruttura base, nessuna ridondanza, possibili interruzioni durante manutenzione, disponibilità circa 99,67% (29 ore/anno di indisponibilità)

- Tier 2 ->Componenti ridondati parzialmente, maggiore affidabilità rispetto al Tier 1, Disponibilità circa 99,75% (26 ore/anno di indisponibilità)

- Tier 3 ->Manutenzione senza interruzione del servizio, ridondanza completa dei sistemi critici, disponibilità circa 99,98% (1,6 ore/anno di indisponibilità)

- Tier 4 -> Fault tolerant completo, doppia alimentazione, doppia rete, doppio raffreddamento, disponibilità circa 99,995% (26 minuti/anno di indisponibilità)

Maggiore è il livello Tier, maggiore è la capacità del data center di garantire continuità operativa.

Soluzioni per la continuità operativa

E’ fondamentale dunque garantire continuità di servizio in un data center virtualizzato.

Un ambiente ben progettato garantisce:

- Ridondanza e duplicazione (Ad esempio RAID)

- Cluster di server

- Sistemi di archiviazione (Ad esempio Live migration e snapshot)

RAID (Redundant Array of Independent Disks)

Il RAID è una tecnologia che combina più dischi fisici in un’unica unità logica per migliorare affidabilità e/o prestazioni.

Principali livelli:

- RAID 0 → prestazioni elevate, nessuna ridondanza

- RAID 1 → mirroring, duplicazione dei dati

- RAID 5 → parità distribuita, buon compromesso tra sicurezza e capacità

- RAID 6 → doppia parità

- RAID 10 → combinazione di mirroring e striping

Il RAID aumenta la tolleranza ai guasti, ma non sostituisce il backup.

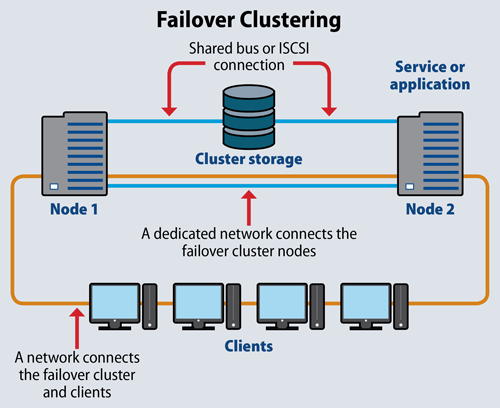

Cluster di Server

Un cluster è un insieme di server che lavorano come un unico sistema logico per garantire alta disponibilità. Con i Cluster di Failover se un nodo si guasta, un altro prende automaticamente il suo posto. Questo meccanismo riduce al minimo il downtime.

Heartbeat Network

È una rete dedicata tra i nodi del cluster che consente ai server di “monitorarsi” reciprocamente. Se un nodo non invia più il segnale di heartbeat, viene considerato guasto e sostituito.

Funzioni avanzate

Migrazione live (Live Migration)

Permette di spostare una macchina virtuale da un server fisico a un altro senza interrompere il servizio. Stesso accade anche per la migrazione di storage.

Snapshot

Creazione di un’istantanea dello stato di una macchina virtuale in un determinato momento. Utile per: test, aggiornamenti software, ripristino rapido in caso di errore

Cloud Computing

Introduzione: dai Data Center fisici al Cloud

L’evoluzione dell’informatica aziendale ha seguito un percorso chiaro: dai server fisici dedicati, ospitati nei data center tradizionali, si è passati alla virtualizzazione, fino ad arrivare al cloud computing.

Se nel modello tradizionale un’organizzazione acquistava, installava e gestiva direttamente hardware, sistemi operativi e applicazioni, nel modello cloud le risorse diventano servizi erogati attraverso Internet, accessibili in modo dinamico e scalabile.

Il cloud rappresenta quindi una trasformazione concettuale: non più infrastrutture statiche da possedere, ma risorse flessibili da consumare.

Dal possesso al servizio

Il passaggio fondamentale è culturale oltre che tecnologico:

- Prima: acquisto di server, licenze, storage, gestione interna.

- Oggi: accesso on-demand a potenza di calcolo, spazio disco e piattaforme applicative tramite rete.

Un’analogia efficace è quella dell’energia elettrica: non si possiede una centrale elettrica, ma si paga il consumo. Allo stesso modo, nel cloud si paga l’utilizzo di CPU, RAM, storage o servizi applicativi.

I vantaggi principali sono:

- Scalabilità immediata

- Riduzione degli investimenti iniziali

- Maggiore flessibilità operativa

- Aggiornamenti e manutenzione delegati al provider

Definizione del NIST

Il National Institute of Standards and Technology (NIST) definisce il cloud computing come un modello che consente un accesso comodo, on-demand e tramite rete a un pool condiviso di risorse configurabili.

Secondo il NIST, il cloud si caratterizza per:

– 5 Caratteristiche Essenziali

-

On-demand self-service

L’utente può attivare risorse autonomamente senza intervento umano del provider. -

Broad network access

I servizi sono accessibili tramite rete da diversi dispositivi. -

Resource pooling

Le risorse sono condivise tra più utenti (multi-tenant). -

Rapid elasticity

Le risorse possono aumentare o diminuire rapidamente in base al carico. -

Measured service

Il consumo è monitorato e fatturato in base all’utilizzo.

– 3 Modelli di Servizio

IaaS – Infrastructure as a Service

Fornisce infrastruttura virtuale (server, storage, rete). L’utente gestisce sistema operativo e applicazioni.

Analogia: affittare un appartamento vuoto da arredare.

Esempio: macchine virtuali su cloud pubblico.

PaaS – Platform as a Service

Fornisce ambiente di sviluppo completo (runtime, database, middleware).

L’utente sviluppa applicazioni senza gestire il sistema operativo.

Analogia: affittare un laboratorio già attrezzato.

SaaS – Software as a Service

Il Software as a Service (SaaS) rappresenta il livello più alto di astrazione nel cloud computing. In questo modello l’utente non gestisce né l’infrastruttura né la piattaforma: utilizza direttamente un’applicazione pronta all’uso, accessibile tramite browser o client dedicato. In un ambiente SaaS il provider gestisce hardware, rete, storage, sistema operativo, middleware e applicazione; l’utente si limita alla configurazione funzionale (account, preferenze, ruoli, dati); aggiornamenti, patch di sicurezza e manutenzione sono completamente centralizzati.

Analogia

Se l’IaaS è come affittare un appartamento vuoto e il PaaS come affittare un laboratorio attrezzato, il SaaS è paragonabile a un servizio alberghiero completo: l’infrastruttura è già pronta, gestita e mantenuta da altri; l’utente utilizza semplicemente il servizio.

Evoluzione del PaaS

- CaaS (Container as a Service) → gestione di container (es. orchestrazione Kubernetes). I container sono pacchetti software autonomi che contengono tutto il necessario per gestire un’applicazione

- FaaS (Function as a Service) → esecuzione di funzioni serverless attivate da eventi, senza gestione di server.

Con FaaS l’utente scrive solo il codice della funzione, il resto è completamente astratto.

– 4 Modelli di Distribuzione

- Cloud Privato → dedicato a una singola organizzazione.

- Cloud Pubblico → condiviso e gestito da provider esterno.

- Cloud Ibrido → integrazione tra pubblico e privato.

- Community Cloud → condiviso tra organizzazioni con esigenze comuni.

Lascia un commento